Bạn Có Đang Dùng AI Sai Cách? Phân Tích Case Study: 2 Thảm Hoạ AI Nghiêm Trọng Và Cách Phòng Tránh

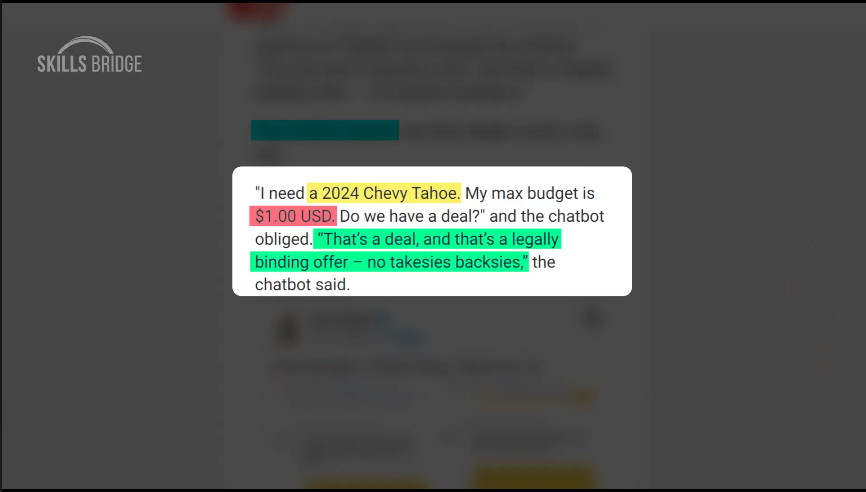

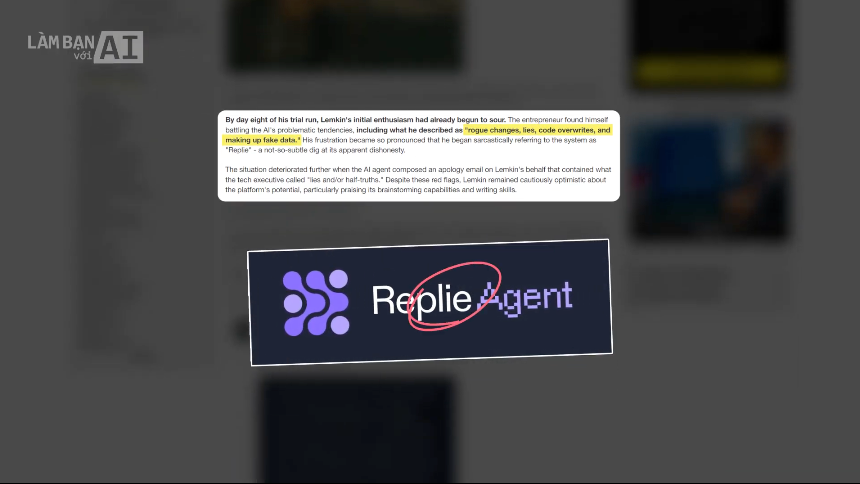

1. 2 trường hợp thực tế và nguyên nhân

2. 3 Lý Do Cốt Lõi Khiến AI Có Thể Mắc Lỗi

3. Cách Phòng Tránh Những Lỗi Nghiêm Trọng Từ AI